网站抓取频率是指搜索引擎或爬虫在单位时间内访问并抓取网站页面的次数,这一频率直接影响网站内容被索引的速度、搜索引擎优化的效果以及服务器的负载情况,了解如何查看网站抓取频率,可以帮助网站管理员优化网站结构、提升搜索引擎友好度,并避免因抓取过度导致服务器压力过大,以下从多个维度详细说明查看网站抓取频率的方法及相关注意事项。

通过搜索引擎站长工具查看抓取频率

主流搜索引擎如Google、百度、Bing等都提供了站长工具(Search Console),这些工具内置了抓取数据统计功能,能够直观展示抓取频率、抓取量、抓取错误等核心指标,以Google Search Console和Baidu Search为例,具体操作步骤如下:

Google Search Console

Google Search Console的“抓取”板块提供了“抓取统计”和“抓取错误”两个核心报告。

- 抓取统计:在“抓取”菜单中选择“抓取统计”,系统会展示过去90天内Google抓取您网站的次数(以“抓取请求”为单位)以及抓取的数据量(以“MB”为单位),通过图表可以清晰看到抓取频率的波动趋势,例如是否在特定日期出现高峰或低谷。

- 抓取速度:该指标显示Google抓取您网站的平均速度(如“每秒请求数”),若速度过高(如超过10次/秒),可能意味着服务器负载过大,需通过robots.txt或抓取预算工具进行调整。

百度搜索资源平台

百度搜索资源平台的“抓取诊断”功能提供了更详细的中文本地化数据:

- 抓取频次:在“抓取诊断”页面,可以查看百度近7天、30天的抓取次数,包括“总抓取次数”“成功抓取次数”和“失败抓取次数”,失败次数过高可能提示网站存在404错误、robots.txt配置问题或服务器响应慢等障碍。

- 抓取趋势图:支持按时间段筛选,观察抓取频率与网站更新(如发布新文章)或服务器维护的关联性,例如新内容发布后抓取频率是否明显提升。

注意事项:使用站长工具需验证网站所有权,且数据存在一定延迟(通常为24-48小时),需结合长期数据观察趋势而非单日波动。

分析服务器日志获取精准抓取数据

服务器日志是记录所有访问请求的原始文件,通过分析日志可以精准识别搜索引擎爬虫的抓取行为,包括抓取频率、抓取路径、请求时间段等,且数据不受第三方工具延迟影响,以下是具体操作步骤:

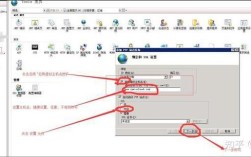

获取服务器日志

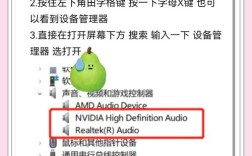

不同服务器环境(如Apache、Nginx)的日志存储位置不同:

- Apache服务器:默认日志路径为

/var/log/apache2/access.log(Linux系统)或C:\Apache24\logs\access.log(Windows系统); - Nginx服务器:默认路径为

/var/log/nginx/access.log。

若使用虚拟主机,可联系主机商下载指定时间段的日志文件(建议按天或按小时分割,便于分析)。

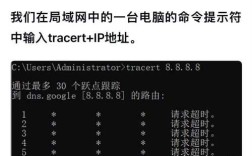

使用工具分析日志

推荐使用命令行工具(如Linux的grep、awk)或可视化工具(如GoAccess、AWStats)进行分析,以GoAccess为例:

- 安装GoAccess后,通过命令

goaccess /var/log/nginx/access.log -o report.html --real-time-html生成实时报告; - 在“Visitors”模块中,可按“User Agent”筛选爬虫(如Googlebot、Baiduspider),查看其请求次数、请求时间段分布(如每小时抓取次数)和抓取的URL路径。

关键指标提取

通过日志分析可重点关注以下指标:

- 爬虫标识:通过User Agent识别搜索引擎爬虫(如Googlebot的特征为“Googlebot/2.1”),排除普通用户和其他爬虫的干扰;

- 抓取间隔:统计同一爬虫两次连续请求的平均时间间隔,间隔越短说明抓取频率越高;

- 抓取深度:观察爬虫是否频繁访问深层目录(如

/category/page/2/),可能提示网站结构存在过度分页或重复内容问题。

优势:日志数据直接来自服务器,精准度高,可自定义分析维度(如按IP、URL、时间段筛选),适合需要深度排查抓取问题的场景。

利用第三方SEO工具监控抓取频率

部分第三方SEO工具提供了网站抓取频率的监控功能,虽然数据可能不如日志精准,但胜在操作简便且支持多平台对比,常用工具包括:

Screaming Frog SEO Spider

这款工具常用于网站爬取,但其“Crawl Statistics”报告可展示抓取频率相关数据:

- 在“Configuration”中设置“Crawl Rate”(如“ polite crawl”模式下限制每秒请求数),模拟搜索引擎抓取行为;

- 抓取完成后,在“Reports”中选择“Crawl Statistics”,查看“Requests per Second”和“Total Requests”,结合抓取时长可计算平均抓取频率(如总请求次数/抓取小时数)。

Ahrefs Site Audit

Ahrefs的网站审计功能会定期模拟爬虫抓取网站,并在“Site Audit”报告的“Crawlability”板块中展示:

- Crawl Health:包括抓取成功率(如95%表示5%的页面因错误无法抓取)、平均抓取速度;

- Crawl Budget:估算搜索引擎每天可抓取的页面数,若抓取频率远低于预算,可能提示网站未被充分重视。

局限性:第三方工具多为付费服务,且数据基于其自身爬虫模拟,可能与真实搜索引擎抓取行为存在偏差,需结合站长工具和日志数据交叉验证。

通过robots.txt和sitemap.xml间接判断抓取频率

robots.txt文件和sitemap.xml文件虽不直接显示抓取频率,但可通过其配置和搜索引擎的响应情况间接推测抓取意图:

robots.txt文件检查

robots.txt是爬虫抓取网站的“指令手册”,若发现:

- 搜索引擎爬虫频繁访问robots.txt文件(可通过日志查看),可能说明其在重新读取抓取规则;

- 某些目录被禁止抓取(如

Disallow: /private/),但爬虫仍频繁尝试访问,可能提示robots.txt配置错误或爬虫行为异常。

可通过站长工具的“robots.txt测试”功能验证语法正确性,避免因配置错误导致抓取频率异常。

sitemap.xml提交与更新

sitemap.xml是网站地图,向搜索引擎提交并定期更新(如每日新增页面后更新sitemap),可引导爬虫高效抓取新内容,若发现:

- 提交sitemap后,抓取频率未提升,可能提示sitemap中存在大量无效链接或页面质量过低;

- 爬虫频繁抓取sitemap.xml文件(如每小时访问1次),说明其对网站更新较为关注,抓取频率可能处于较高水平。

抓取频率异常的排查与优化

通过上述方法发现抓取频率异常(如过高或过低)时,需进一步排查原因并优化:

- 抓取频率过高:检查是否存在大量重复内容(如参数URL分页)、服务器响应速度慢(建议优化CDN配置、压缩资源),或通过robots.txt限制非关键目录的抓取频率;

- 抓取频率过低:确保网站内容更新规律(如每日发布原创内容)、sitemap.xml正确提交且无404错误,同时减少页面加载时间(Google建议低于3秒),提升爬抓取效率。

相关问答FAQs

Q1:为什么站长工具显示的抓取频率与日志分析结果不一致?

A:可能原因包括:①站长工具数据存在24-48小时延迟,而日志分析为实时数据;②站长工具仅统计主流搜索引擎爬虫(如Googlebot、Baiduspider),日志中可能包含其他爬虫或工具爬虫的请求;③部分爬虫可能未正确标识User Agent,导致站长工具未统计,建议以日志数据为准,站长工具作为趋势参考。

Q2:如何判断网站抓取频率是否合理?

A:抓取频率是否需结合网站规模、更新频率和服务器承载能力综合判断。①中小型网站(页面数<1万)每日更新5-10篇原创内容,合理抓取频率为每日50-200次;②大型电商网站(页面数>10万)若每日新增1000个商品页,抓取频率可提升至每日1000-5000次;③若服务器负载(CPU、内存)因抓取频繁超过80%,需通过限制爬取速率或优化页面结构进行调整。