搜索引擎需先采集网页数据,经解析、去重与索引构建形成倒排表;再借分词算法处理查询词,依索引快速定位结果并排序展示,同时优化性能与更新

如何搭建一个搜索引擎

搭建一个搜索引擎是一项复杂但非常有成就感的任务,它涉及多个步骤和技术组件,以下是详细的指南,涵盖从基础架构到高级优化的各个阶段,本文将结合理论与实践,提供具体的代码示例和工具推荐,帮助你逐步构建自己的搜索引擎。

核心原理

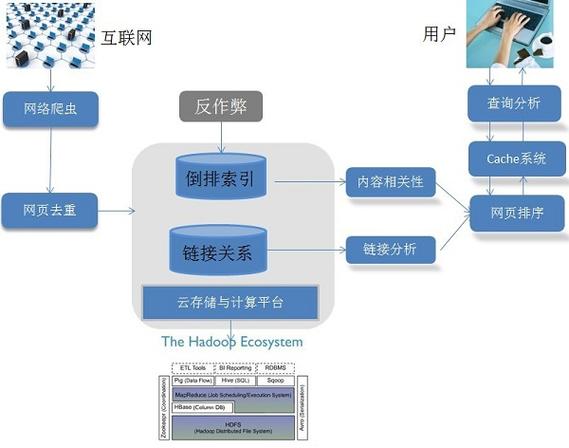

搜索引擎的核心逻辑包括三个主要环节:数据收集(爬虫)、索引构建、查询处理,其本质是通过建立高效的“映射关系”,实现快速的信息检索。

- 正排索引:按文档ID排序存储内容,类似书籍目录;

- 倒排索引:根据关键词反向关联相关文档列表,这是提升搜索效率的关键数据结构,当用户输入关键词时,系统会先分词、过滤停用词,再利用倒排索引匹配文档并排序返回结果。

技术选型与环境准备

以下是几种主流方案及其适用场景: | 方案类型 | 代表工具/框架 | 特点 | 适合对象 | |----------------|-----------------------|-------------------------------------------|------------------------------| | 开源聚合引擎 | SearXNG | 隐私优先,支持多源聚合搜索 | 希望快速部署且注重用户隐私者 | | 全文检索库 | Elasticsearch | 基于Lucene封装,提供REST API和分布式能力 | 需处理结构化/非结构化大数据的企业级应用 | | 自研轻量级实现 | Java+Ansj分词库组合 | 灵活可控,适合学习底层机制 | 开发者用于教学或定制化需求 |

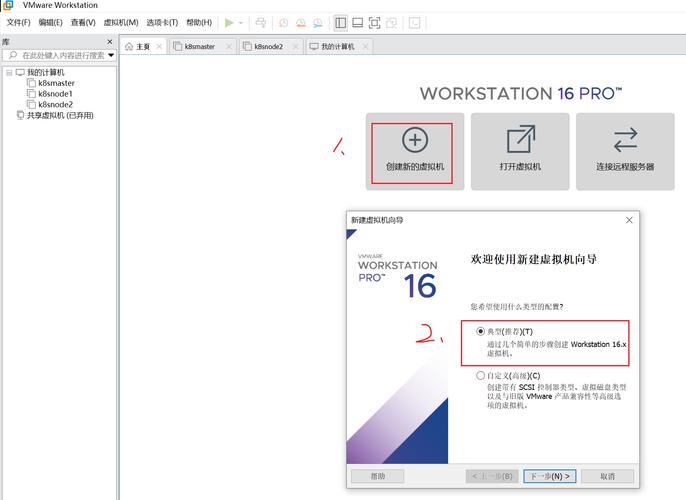

环境要求:若选择Elasticsearch路线,需先安装Java环境并配置JAVA_HOME变量;若采用Docker部署SearXNG,则需准备好服务器及域名解析设置。

分步实施指南

网页解析与内容提取

创建Parser类递归遍历目标目录下的HTML文件,提取标题、URL和正文内容:

// 示例:从文件名获取标题(去除.html后缀)

private String parseTitle(File file) {

String rm = ".html";

return file.getName().substring(0, file.getName().length() rm.length());

}

// 生成标准化URL(本地路径转线上链接)

private String parseUrl(File file) {

String prefix = "https://docs.oracle.com/javase/8/docs/api/";

String suffix = file.getAbsolutePath().substring(ROOT_PATH.length());

return prefix + suffix;

}

// 使用正则表达式清洗正文文本(去标签、合并空格)

public String parseContentByRegex(File file) {

String content = readFile(file);

content = content.replaceAll("<script.?>(.?)</script>", " "); // 移除JS代码

content = content.replaceAll("<.?>", " "); // 剔除HTML标签

content = content.replaceAll("\\s+", " "); // 压缩多余空白字符

return content;

}

此阶段重点是通过正则表达式净化原始数据,为后续索引做准备。

索引系统设计

构建双索引体系以平衡读写性能:

- 正排索引(

ArrayList<Document>):按文档ID顺序存储完整文档对象; - 倒排索引(

HashMap<String, ArrayList<Weight>>):记录每个词汇对应的文档权重列表,在Java中可定义如下结构:public class Index { ArrayList<Document> forwardIndex = new ArrayList<>(); // 正排索引 HashMap<String, ArrayList<Weight>> invertedIndex = new HashMap<>(); // 倒排索引 }持久化存储时,可将索引序列化为JSON文件(如使用Jackson库),便于重启后快速加载。

分词与语言处理

引入第三方库实现智能切词,以中文为例,推荐使用Ansj分词工具:

import org.ansj.domain.Term;

import org.ansj.splitWord.analysis.ToAnalysis;

List<Term> terms = ToAnalysis.parse(inputText).getTerms(); // 获取分词结果列表

for (Term term : terms) {

System.out.println(term.getName()); // 输出每个词语的内容

}

对于英文场景,可扩展停用词表过滤介词、冠词等无意义词汇,提高检索精度。

搜索流程实现

用户发起查询请求后,执行以下操作链:

- 请求解析:接收关键词并拆分为独立单元;

- 索引查找:在倒排索引中定位相关文档集合;

- 相关性排序:根据TF-IDF算法或自定义权重模型对结果打分;

- 结果封装:提取文档摘要、高亮匹配片段等信息返回给前端。

示例伪代码逻辑:

class Searcher {

public List<SearchResult> execute(String query) {

List<String> tokens = tokenize(query); // Step 1: 分词

Set<Integer> docIds = collectDocIds(tokens); // Step 2: 找候选文档

return rankResults(docIds, tokens); // Step 3+4: 排序与包装结果

}

}

进阶优化策略

| 优化方向 | 具体措施 | 收益分析 |

|---|---|---|

| 多线程加速 | 使用线程池并行处理文件解析任务,配合CountDownLatch同步控制流程 | 显著缩短批量索引构建时间 |

| 缓存机制 | 对高频访问的热门词建立内存缓存,减少磁盘I/O消耗 | 降低响应延迟 |

| 分布式扩展 | 借助Elasticsearch集群实现水平扩展,支持PB级数据处理 | 应对大规模数据场景 |

| 中文分词增强 | 集成IK Analyzer插件优化中文语义识别 | 提升中文搜索准确率 |

在Elasticsearch中启用中文分词插件的命令如下:

./bin/elasticsearch-plugin install https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v8.14.0/elasticsearch-analysis-ik-8.14.0.zip

随后在创建索引时指定分析器类型即可生效。

现成解决方案推荐

如果希望跳过底层开发直接部署可用实例,可选择以下成熟项目:

- SearXNG:通过Docker容器一键启动,支持绑定自定义域名和HTTPS证书配置,只需执行以下命令:

docker pull searxng/searxng # 拉取镜像 # 在宝塔面板创建容器并映射端口8081 # 通过反向代理绑定域名(如yourdomain.com → http://服务器ip:8081)

该方案尤其适合个人站长快速搭建去中心化元搜索引擎;

- Elastic Stack:官方提供的Kibana可视化工具可辅助监控集群状态、调试查询语法,适合企业级应用监控需求。

相关问题与解答

Q1: 为什么需要同时维护正排索引和倒排索引?

A: 正排索引用于直接获取文档详情(如按ID读取完整内容),而倒排索引负责关键词到文档的映射关系,两者结合既能高效定位数据范围,又能快速完成关键词匹配,是搜索引擎性能的基础保障,缺少任一都会导致功能缺陷:仅有正排无法实现快速关键词搜索;仅有倒排则难以展示原始文档全貌。

Q2: SearXNG与自建Elasticsearch的本质区别是什么?

A: SearXNG属于元搜索引擎,本身不存储任何数据,而是代理用户请求到其他引擎(如Google、Bing)并整合结果,其优势在于零数据采集成本和隐私保护;而Elasticsearch需要自行导入和管理数据集,适合拥有专属语料库的场景,前者侧重聚合服务,后者强调自主可控性。