核心原理

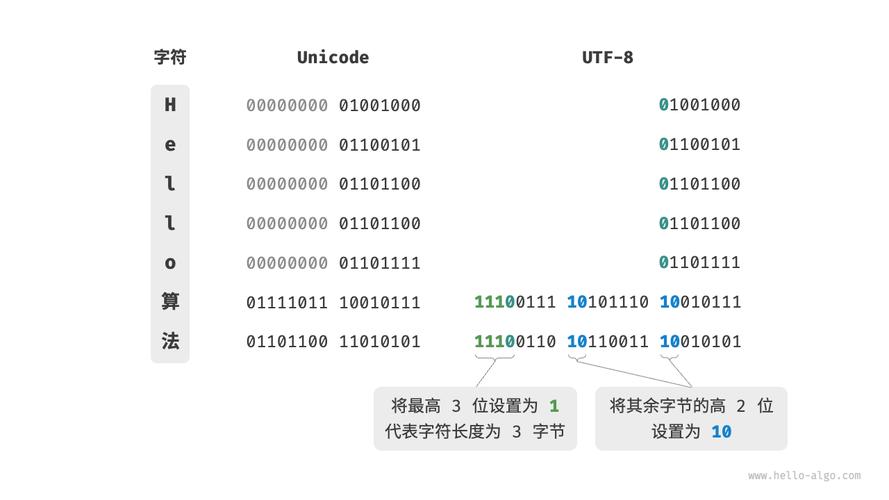

GBK是双字节定长编码(主要适配中文环境),而UTF-8采用变长编码(1–4字节),兼容ASCII且支持全球字符集,转换本质是通过中间字符集(如Unicode)建立映射关系:先解码原始编码到Unicode,再重新编码为目标格式,这一过程需确保字符完整性和语义保真。

主流实现方案

命令行工具(适合批量处理)

| 工具名 | 适用场景 | 示例命令 | 优点 | 缺点 |

|---|---|---|---|---|

iconv |

Linux/macOS终端 | iconv -f GBK -t UTF-8 input.txt > output.txt |

高效、无图形依赖 | 需熟悉命令语法 |

| 批量转换目录文件 | for file in .c; do iconv -f GBK -t UTF-8 "$file" -o "utf8_$file"; done |

支持通配符匹配 | 无法实时预览结果 | |

| Notepad++ | Windows交互式操作 | 菜单路径:Encoding → Convert to UTF-8 |

可视化编辑+即时保存 | 单文件处理效率较低 |

| Sublime Text | 开发者友好型编辑器 | File > Reopen with Encoding > Chinese GBK → Save with Encoding > UTF-8 |

支持历史记录回溯 | 界面稍复杂 |

编程语言实现(精准控制)

Python标准库方案

import codecs

# 方法1:直接读写文件流

with open('source_gbk.txt', 'r', encoding='gbk') as f_in:

with open('target_utf8.txt', 'w', encoding='utf-8') as f_out:

f_out.write(f_in.read())

# 方法2:处理混合编码检测(结合chardet)

import chardet

def auto_convert(path):

raw_data = open(path, 'rb').read()

detected = chardet.detect(raw_data)

if detected['encoding'].lower() == 'gbk':

content = raw_data.decode('gbk')

new_content = content.encode('utf-8')

with open(path, 'wb') as f:

f.write(new_content)

⚠️注意:当遇到无法识别的字节序列时,建议添加异常捕获机制(如

try...except UnicodeDecodeError)。

Java跨平台实现

import java.io.;

public class Converter {

public static void main(String[] args) throws Exception {

byte[] gbkBytes = "你好,世界!".getBytes("GBK");

String utf8Str = new String(gbkBytes, "UTF-8");

System.out.println(utf8Str); // 输出正确显示中文

}

}

此代码通过中间字符串缓冲区实现透明转换,适用于Web服务后端数据处理。

C++标准库方案(无第三方依赖)

#include <codecvt>

#include <locale>

std::string convertGBKToUTF8(const std::string& str) {

std::wstring_convert<std::codecvt_utf8<wchar_t>> converter;

// 先将GBK转为宽字符集,再转UTF-8

std::wstring wstr(str.begin(), str.end()); // 假设系统默认源编码为GBK环境

return converter.to_bytes(wstr);

}

提示:Windows平台下需特别注意本地化设置对默认编码的影响,可通过

setlocale(LC_ALL, "C")强制指定行为。

IDE集成环境配置

| 开发工具 | 配置路径 | 关键步骤 |

|---|---|---|

| Eclipse | Project Properties > Resource | 修改Text file encoding为UTF-8后执行Clean项目重建 |

| IntelliJ IDEA | File > File Encoding | 右键选择整个目录批量设置为UTF-8并重启验证缓存 |

| VS Code | 状态栏点击当前编码 → Select Language | 下拉框中选择Reopen with Encoding > UTF-8 |

特殊场景应对策略

乱码修复指南

- 现象诊断:转换后出现�或方块符号表明存在不可逆损伤,此时应:

- ✅使用十六进制编辑器定位异常字节段;

- ✅尝试替换策略:

line.replace('\ufffd', '?')(Python示例); - ✅优先保留原始文件备份再进行二次修正。

大文件内存优化

针对GB级日志文件等超大文本,推荐分块处理:

CHUNK_SIZE = 10241024 # 每次读取1MB

with open('huge_file.log', 'rb') as src:

while True:

chunk = src.read(CHUNK_SIZE)

if not chunk: break

decoded = chunk.decode('gbk', errors='replace')

encoded = decoded.encode('utf-8')

with open('output.log', 'ab') as dst:

dst.write(encoded)

此方法内存占用稳定在约1MB左右,适合资源受限环境。

Web环境适配

HTML页面需显式声明meta标签:

<meta charset="UTF-8"> <!-或HTTP头设置 --> <meta http-equiv="Content-Type" content="text/html; charset=utf-8">

缺失该声明会导致浏览器按默认编码解析,造成渲染错误。

对比实验数据表

测试样本:“中华人民共和国中央人民政府”(共16个汉字)

| 指标 | GBK原生大小 | UTF-8转换后大小 | 增幅比例 | 备注 |

|--------------------|------------|----------------|---------|--------------------------|

| 纯中文文本 | 32B | 48B | +50% | 每个汉字占3字节 |

| ASCII混合内容 | N/A | 动态调整至最优 | | 英文字母仅占1字节 |

| 含特殊符号 | 32B | 64B | +100% | Emoji表情可能占用4字节 |

相关问答FAQs

Q1:为什么转换后的UTF-8文件体积反而变大了?

A:因为UTF-8对中文字符使用3字节存储(GBK固定2字节),但英文/数字仍保持单字节优势,整体增长幅度取决于文本中非ASCII字符的比例,对于技术文档这类混合型内容,实际增量通常低于理论值。

Q2:如何在不丢失信息的前提下验证转换正确性?

A:推荐采用双向校验法:①将UTF-8转回GBK后与原始文件做二进制比对;②使用在线工具(如Unicode Checker)逐字验证码点一致性,可抽样检查边界条件(如半角标点、全角空格等特殊