下面我将从最可能的原因开始,由浅入深,为你提供一套完整的排查和解决方案。

问题根源分析

当你在终端输入 hadoop 并按下回车后,系统会按照特定的顺序在一系列目录中查找名为 hadoop 的可执行文件,如果所有这些路径下都没有找到,系统就会提示 "command not found"。

问题的核心原因只有一个:系统的 PATH 环境变量没有包含 Hadoop 可执行文件所在的目录。

解决方案(按优先级排序)

请按照以下步骤逐一排查和尝试。

检查 Hadoop 是否已安装(最基础)

确认 Hadoop 是否真的已经安装在你的系统中。

# 查找 hadoop 命令的完整路径(如果存在) which hadoop # 或者 whereis hadoop

- 如果返回了路径(

/usr/local/hadoop/bin/hadoop),说明 Hadoop 已安装,但PATH配置有问题,请直接跳到 方案二。 - 如果没有任何输出,说明 Hadoop 可能根本没有安装,或者安装路径不正确,请先确认 Hadoop 的安装目录,通常是

/usr/local/hadoop或/opt/hadoop。

# 检查 Hadoop 安装目录是否存在 ls /usr/local/hadoop # 或者 ls /opt/hadoop

如果目录不存在,你需要先安装 Hadoop。

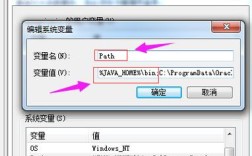

将 Hadoop 添加到 PATH 环境变量(最常见的原因)

这是最根本的解决方法,你需要告诉系统去哪里找 hadoop 命令。

找到 Hadoop 的 bin 目录

Hadoop 的所有命令(如 hadoop, hdfs, yarn)都位于其安装目录下的 bin 文件夹中,假设你的 Hadoop 安装在 /usr/local/hadoop,那么这个目录就是 /usr/local/hadoop/bin。

修改配置文件以永久添加 PATH

为了使配置在每次重启后都生效,你需要修改用户配置文件,根据你使用的 Shell,文件可能不同。

-

对于 Bash Shell (最常见): 编辑

~/.bashrc文件。# 使用 vim 或 nano 等编辑器打开文件 vim ~/.bashrc

在文件末尾添加以下内容(请务必将

/usr/local/hadoop替换为你自己的 Hadoop 安装路径):# Set Hadoop environment export HADOOP_HOME=/usr/local/hadoop export PATH=$PATH:$HADOOP_HOME/bin

保存并退出(在 vim 中是

wq)。 -

对于 Zsh Shell (macOS Catalina 及以后版本默认使用): 编辑

~/.zshrc文件。vim ~/.zshrc

同样在文件末尾添加:

# Set Hadoop environment export HADOOP_HOME=/usr/local/hadoop export PATH=$PATH:$HADOOP_HOME/bin

保存并退出。

使配置立即生效

修改完配置文件后,你需要让当前的 Shell 会话加载新的配置,而无需重启。

# 对于 Bash Shell source ~/.bashrc # 对于 Zsh Shell source ~/.zshrc

验证

再次尝试 hadoop 命令,应该就能正常工作了。

hadoop version

如果成功输出 Hadoop 的版本信息,恭喜你,问题已解决!

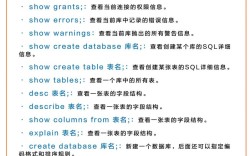

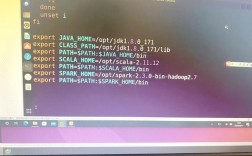

检查 Hadoop 环境变量是否完整(针对 YARN 和 HDFS)

仅仅添加 bin 目录到 PATH 可能不够,特别是当你运行 HDFS 或 YARN 相关命令时,通常还需要设置 HADOOP_HOME 和 HADOOP_CONF_DIR。

在 方案二 的基础上,确保你的配置文件中包含了所有必要的环境变量。

在 ~/.bashrc 或 ~/.zshrc 中添加:

# --- Hadoop Environment Variables --- # 1. Hadoop 的主安装目录 export HADOOP_HOME=/usr/local/hadoop # 2. 将 Hadoop 的 bin 和 sbin 目录添加到 PATH # bin 目录包含用户命令 (hadoop, hdfs) # sbin 目录包含管理员命令 (start-dfs.sh, start-yarn.sh) export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin # 3. (可选但推荐) 指定 Hadoop 配置文件目录 # 这通常指向 HADOOP_HOME/etc/hadoop export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop # 4. (可选) 为 Java 设置 HADOOP_OPTS,如果遇到内存问题 # export HADOOP_OPTS="-Xmx1024m"

添加完成后,同样执行 source ~/.bashrc (或 zshrc) 来使配置生效。

检查 Shell 登录方式

你可能会遇到一种情况:通过 ssh 登录到服务器时命令找不到,但直接在服务器控制台操作时却可以。

这是因为:

- 交互式登录 Shell(如你直接在服务器上登录)会加载

~/.profile或~/.bash_profile等文件。 - 非交互式 Shell(如

ssh后直接执行命令)可能只加载~/.bashrc。

确保你在 ~/.profile 或 ~/.bash_profile 中也添加了相应的 PATH 配置。

# 编辑 ~/.profile vim ~/.profile # 添加如下内容 export HADOOP_HOME=/usr/local/hadoop export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin # 保存后,让配置生效 source ~/.profile

检查权限问题

Hadoop 安装不正确,或者你使用的用户没有执行权限,也可能导致命令找不到。

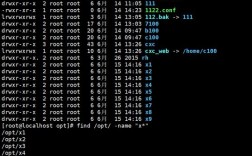

# 进入 Hadoop 安装目录 cd /usr/local/hadoop # 检查 bin 目录的权限 ls -l bin/ # 确保你有读取和执行的权限 # 如果没有,可以使用 chmod 修改 # sudo chmod 755 bin/* # sudo chmod 755 sbin/*

总结排查清单

遇到 "hadoop command not found" 时,请按以下清单检查:

- [ ] Hadoop 已安装? ->

ls /usr/local/hadoop,确认目录存在。 - [ ]

PATH包含bin目录? -> 编辑~/.bashrc或~/.zshrc,添加export PATH=$PATH:/path/to/hadoop/bin。 - [ ]

HADOOP_HOME设置正确? -> 在配置文件中添加export HADOOP_HOME=/path/to/hadoop。 - [ ] 配置已生效? -> 执行

source ~/.bashrc。 - [ ] 命令是否完整? -> 尝试

/usr/local/hadoop/bin/hadoop version,如果这个可以,说明就是PATH的问题。 - [ ] 是否通过

ssh登录? -> 检查~/.profile文件。 - [ ] 文件权限是否正确? ->

ls -l /usr/local/hadoop/bin。

按照这个流程,99% 的 "hadoop command not found" 问题都能得到解决,祝你成功!