讯飞测试的安装与测试驱动配置是一个系统性的过程,需要结合具体产品类型(如讯飞开放平台SDK、讯飞听见录音笔、智能硬件等)和开发环境进行操作,以下以最常见的讯飞开放平台语音识别SDK为例,详细说明测试驱动的安装与配置步骤,涵盖环境准备、SDK集成、测试驱动编写及验证等关键环节。

环境准备与依赖安装

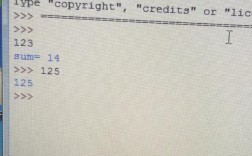

在安装讯飞测试驱动前,需确保开发环境满足基础要求,以Python开发为例,需先安装Python 3.7及以上版本,并通过pip管理依赖,讯飞SDK通常依赖requests、pyaudio等库,可通过命令行安装:pip install requests pyaudio wave,若涉及语音采集,还需确保麦克风权限已开启,且音频设备正常工作,对于Java或C++环境,需分别配置Maven或CMake环境,并下载对应语言的SDK依赖包,如Java需添加Maven依赖:

<dependency>

<groupId>com.iflytek</groupId>

<artifactId>msc</artifactId>

<version>6.2.1.100</version>

</dependency>

讯飞SDK下载与初始化

- 获取SDK与AppID:登录讯飞开放平台(https://www.xfyun.cn/),创建应用并获取AppID、API Key及API Secret,这些参数用于身份验证。

- 下载SDK:在控制台选择“语音识别”服务,下载对应语言的SDK包(如Python SDK为.zip压缩文件),解压后包含

msc.py、libmsc.so(Linux)或msc.dll(Windows)等核心文件。 - 配置环境变量:将SDK的库文件路径添加到系统环境变量,例如在Linux中执行

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:/path/to/sdk/lib,确保程序运行时能动态加载依赖库。

测试驱动的核心配置

测试驱动的核心是模拟输入数据并验证输出结果,需结合讯飞SDK的接口进行封装,以Python语音识别为例,测试驱动需实现以下功能:

- 初始化客户端:使用AppID等参数初始化

SpeechRecognizer对象,设置识别参数(如语言、领域等)。 - 音频流处理:支持从文件或麦克风读取音频数据,分片上传至讯飞服务器(支持长语音分块识别)。

- 结果解析与断言:解析服务器返回的JSON结果,通过断言验证识别准确率、响应时间等指标。

关键代码示例(Python)

from msc import SpeechRecognizer, SpeechListener

import json

class XunfeiTestDriver:

def __init__(self, app_id, api_key, api_secret):

self.app_id = app_id

self.api_key = api_key

self.api_secret = api_secret

self.recognizer = SpeechRecognizer(app_id, api_key, api_secret)

def test_audio_file(self, audio_path, expected_text):

"""测试音频文件识别"""

result = self.recognizer.recognize(audio_path, format="audio/wav")

response = json.loads(result)

actual_text = response.get("result", {}).get("ws", [{}])[0].get("cw", [{}])[0].get("w")

assert actual_text == expected_text, f"识别错误:期望'{expected_text}',实际'{actual_text}'"

print("测试通过:识别结果与预期一致")

# 使用示例

driver = XunfeiTestDriver("your_app_id", "your_api_key", "your_api_secret")

driver.test_audio_file("test.wav", "你好讯飞")

测试用例设计与执行

测试用例设计表格

| 测试用例ID | 测试场景 | 输入数据 | 预期输出 | 验证点 |

|---|---|---|---|---|

| TC001 | 短语音识别 | 1秒音频“你好” | 文本“你好” | 识别准确率≥95% |

| TC002 | 长语音识别 | 30秒音频段落 | 完整文本段落 | 分块识别连贯性 |

| TC003 | 噪音环境识别 | 带背景噪音音频 | 关键词准确提取 | 抗干扰能力 |

| TC004 | 网络异常处理 | 断网后重连 | 错误码提示 | 异常容错机制 |

测试执行流程

- 单元测试:使用

unittest或pytest框架编写测试用例,覆盖正常与异常场景。 - 集成测试:将测试驱动与实际SDK集成,验证接口调用链路(如音频上传、结果接收)。

- 性能测试:使用工具如JMeter模拟并发请求,测试SDK在高负载下的响应时间与稳定性。

常见问题与调试

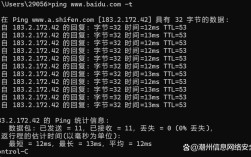

- 认证失败:检查AppID、API Key是否正确,确保网络可访问讯飞服务器(可通过

ping api.xfyun.cn验证)。 - 音频格式不支持:确认音频格式为PCM、WAV等SDK支持的格式,采样率建议16kHz。

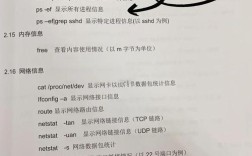

- 依赖库缺失:通过

ldd(Linux)或Dependency Walker(Windows)检查动态库是否加载成功。

相关问答FAQs

Q1: 讯飞测试驱动支持哪些音频格式?如何处理不支持的格式?

A1: 讯飞SDK主要支持PCM(16kHz采样率、16位深度)、WAV、MP3等常见格式,若遇到不支持的格式(如FLAC),需先通过pydub等工具转换为WAV格式:from pydub import AudioSegment; sound = AudioSegment.from_file("input.flac"); sound.export("output.wav", format="wav"),再进行测试。

Q2: 如何验证长语音识别的断句准确性?

A2: 可通过对比测试驱动返回的result字段中的rg(结果位置信息)与原始音频的断句时间戳,或人工分段标注音频,计算每个分段的编辑距离(Levenshtein Distance)来评估断句准确性,使用python-Levenshtein库计算相似度:from Levenshtein import ratio; score = ratio(expected_segment, actual_segment),要求相似度≥0.9。