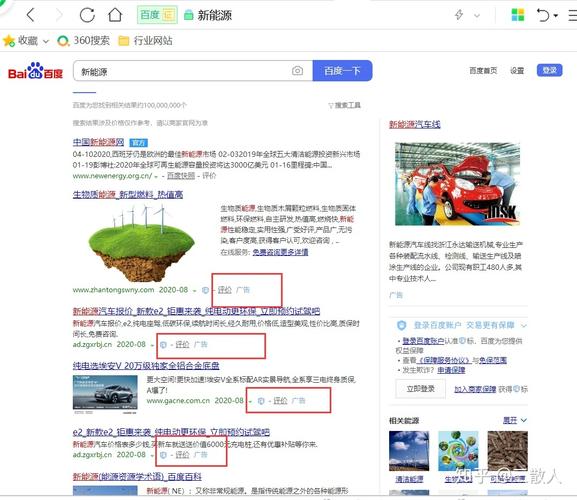

在百度搜索中避免被收录或降低曝光度,需要从网站内容、技术配置、外部链接及运营策略等多维度综合调整,以下从具体操作层面详细说明实现方法,帮助网站根据需求控制百度收录行为。

技术层面的控制措施

技术手段是控制百度收录的基础,通过配置服务器文件和代码指令,可直接向搜索引擎传递收录意愿。

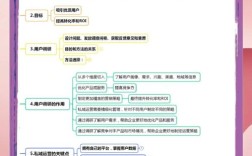

-

Robots.txt协议设置

在网站根目录创建robots.txt文件,明确禁止百度蜘蛛抓取指定目录或页面。User-agent: Baiduspider Disallow: /admin/ # 禁止抓取后台管理目录 Disallow: /temp/ # 禁止抓取临时文件目录 Disallow: /*.php?$ # 禁止抓取所有动态参数页面

需注意,Robots.txt仅对合规搜索引擎生效,恶意爬虫可能忽略该指令。

-

Robots标签使用

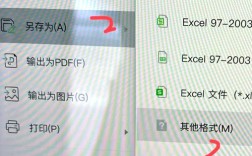

在HTML代码的<head>部分添加<meta name="robots" content="noindex,nofollow">标签,可禁止百度收录当前页面并跟踪页面链接,针对整站控制,可在网站管理系统(如WordPress的SEO插件)中全局设置该标签。 (图片来源网络,侵删)

(图片来源网络,侵删) -

服务器返回头指令

通过.htaccess(Apache)或web.config(IIS)配置HTTP头信息,直接向百度返回禁止收录的指令,例如在.htaccess中添加:<FilesMatch "\.(php|html)$"> Header set X-Robots-Tag "noindex,nofollow" </FilesMatch>

此方法对所有访问该文件的搜索引擎生效,覆盖范围比单页面标签更广。

内容与结构优化策略

百度对低质量或重复内容的收录意愿较低,通过调整内容策略可自然降低收录概率。

-

减少重复内容

避免全站转载或高度相似的内容,尤其对产品列表、分页页面等动态生成内容,添加rel="canonical"标签指定唯一正规链接,防止因内容重复导致收录混乱。 (图片来源网络,侵删)

(图片来源网络,侵删)<link rel="canonical" href="https://www.example.com/product/1">

-

控制页面更新频率

对于无需长期展示的页面(如活动页、促销信息),设置较短的缓存时间或主动删除,降低百度蜘蛛抓取频率,可通过网站管理工具设置页面过期时间(Expires头)。 去重处理**

对用户生成内容(如评论、论坛帖子)启用审核机制,删除垃圾信息;对自动抓取的第三方数据(如新闻聚合)进行原创性改写,避免直接复制。

外部链接与权重控制

外部链接是百度发现网站的重要途径,通过管理外部链接可间接控制收录行为。

-

清理低质量外链

定期通过百度站长工具检查外链来源,对垃圾论坛链接、群发链接等通过Google Disavow工具提交屏蔽列表,降低百度对网站信任度。 -

避免高权重站转载

防止原创内容被大型门户网站(如新闻站、百科平台)未经授权转载,可通过添加版权声明或技术手段(如文本水印)降低转载价值。 -

控制友情链接触及 不相关或已被百度处罚的网站交换友情链接,可能导致网站权重下降,间接影响收录,建议定期检查友情链接状态,及时移除问题站点。

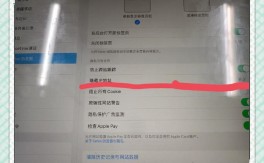

百度站长工具的主动管理

注册并使用百度站长工具,可实现对收录状态的精准控制。

-

URL提交设置

在"普通收录"功能中关闭"自动提交"选项,仅手动提交需要收录的页面,避免百度蜘蛛抓取到不需要的页面。 -

死链提交

定期生成网站死链文件(如sitemap_deadlink.xml),通过站长工具提交,引导百度蜘蛛停止抓取已失效页面。 -

网站改版注意事项

若需调整网站结构,使用"网站改版"功能提交改版规则,避免因URL变更导致大量页面无法收录。

特殊场景的处理方案

针对不同类型的网站,需采取差异化的避免收录策略。

| 网站类型 | 避免收录方法 |

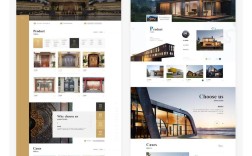

|---|---|

| 企业官网 | 关闭"关于我们""联系方式"等页面的收录,仅保留产品与服务页面;使用robots.txt禁止抓取案例库、招聘页等 |

| 电商平台 | 对商品详情页添加noindex标签,仅保留分类页和品牌页;禁用蜘蛛抓取用户评价、购物车页面 |

| 个人博客/论坛 | 对注册页、私信页、管理后台设置访问权限;对用户发布内容启用延迟收录,审核后再允许百度抓取 |

长期监控与调整

-

定期检查收录情况

通过site:命令(如site:example.com)监控百度收录的页面数量,对异常新增页面及时排查原因。 -

分析蜘蛛日志

服务器开启访问日志记录,分析百度蜘蛛(User-agent为Baiduspider)的抓取路径,发现抓取不需要页面时及时调整robots.txt或页面标签。 -

更新频率控制

若需长期避免收录,可降低网站更新频率,甚至暂时停止内容更新,使百度蜘蛛减少访问频次。

相关问答FAQs

Q1:设置robots.txt禁止抓取后,百度是否一定会遵守?

A:百度等主流搜索引擎会遵守robots.txt协议,但需注意:①协议仅对合规爬虫有效,恶意爬虫可能忽略;②robots.txt禁止抓取的页面仍可能被其他已收录页面链接带入百度索引,需配合noindex标签使用;③大型网站建议定期检查robots.txt语法正确性,避免因格式错误导致指令失效。

Q2:网站已关闭自动提交,为何百度仍收录新页面?

A:关闭百度站长工具的自动提交仅代表网站不再主动推送新页面,但百度仍可能通过以下途径发现页面:①外部链接引导;②网站地图(sitemap.xml)中包含的页面;③用户主动提交;④历史已收录页面的内部链接,若需彻底避免收录,需结合robots.txt、noindex标签及页面访问权限设置共同作用。