是针对Dede程序网站的详细步骤,用于查看百度蜘蛛(Baiduspider)的访问情况:

(图片来源网络,侵删)

通过服务器日志分析

-

获取网站日志文件

- 操作路径:登录到托管网站的服务器或虚拟主机控制面板,找到对应的访问日志,通常命名为

access.log、nginx/logs/目录下的文件,或者在阿里云等云服务商提供的“日志服务”中直接导出原始日志,如果是独立服务器,可通过FTP客户端下载相关日志文件。 - 注意区分环境:不同环境的日志存储位置可能略有差异,例如Linux系统的Apache服务器默认将日志存放在

/var/log/apache2/,而Nginx则可能在自定义的配置路径下,建议提前确认服务器类型和配置。

- 操作路径:登录到托管网站的服务器或虚拟主机控制面板,找到对应的访问日志,通常命名为

-

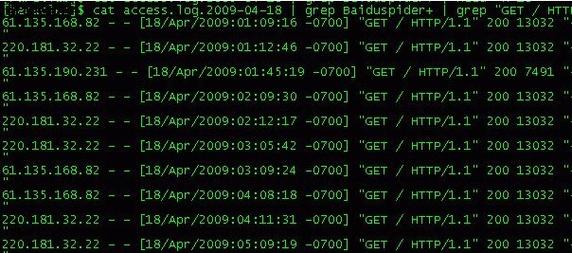

筛选与解析关键信息

- 搜索关键词:使用文本编辑器打开日志后,通过快捷键Ctrl+F输入“Baiduspider”,快速定位所有包含该标识的行,每一行代表一次请求记录,典型格式如下:IP地址 时间戳 [时区] "GET /path/to/page.html HTTP/1.1" User-Agent: Baiduspider...

- 重点关注字段:①用户代理(User-Agent):确认是否为合法的百度爬虫;②请求路径:判断哪些页面被抓取;③响应状态码:如200表示成功,404说明页面不存在;④访问时间:了解蜘蛛的活动规律。

-

验证蜘蛛真实性(防伪造攻击)

- 反向DNS查询:复制日志中的IP地址,在命令提示符执行

nslookup IP或在线工具验证域名归属,真正的百度蜘蛛IP解析结果应包含baidu.com域的信息,若显示其他无关域名,则可能是恶意伪装的流量。 - 对照官方UA列表:检查日志中的User-Agent字符串是否符合百度公布的格式,例如移动版、PC版或小程序场景的不同前缀,异常的用户代理可能是爬虫伪装的迹象。

- 反向DNS查询:复制日志中的IP地址,在命令提示符执行

安装专用插件辅助监控

-

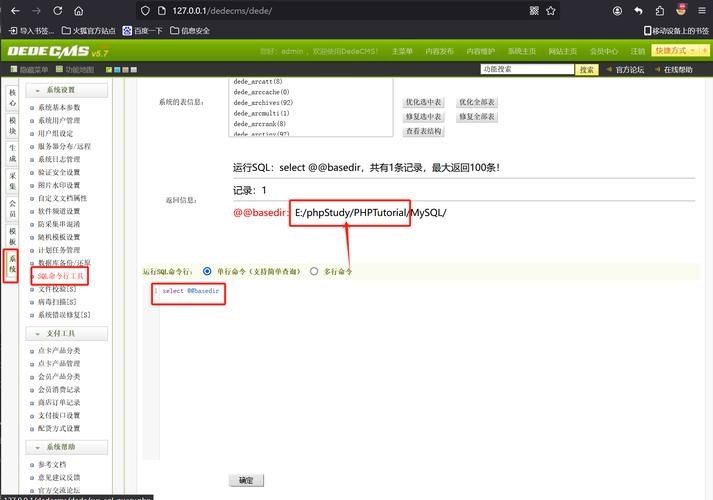

部署DEDE蜘蛛记录插件

(图片来源网络,侵删)

(图片来源网络,侵删)- 工具选择:推荐使用“DEDE各大蜘蛛爬行记录插件”,该插件专为DedeCMS设计,支持多搜索引擎识别及可视化统计功能,下载后解压至网站的

/include目录,并在后台启用即可自动运行。 - 配置说明:安装完成后进入插件管理页面,设置参数包括日志保留天数、是否显示图表等,部分高级版本还允许设置告警阈值,当异常流量突增时发送邮件通知管理员。

- 工具选择:推荐使用“DEDE各大蜘蛛爬行记录插件”,该插件专为DedeCMS设计,支持多搜索引擎识别及可视化统计功能,下载后解压至网站的

-

解读插件生成的报告

- 数据维度:插件会汇总每日/每周的爬虫活跃度、热门抓取路径、平均停留时长等指标,若发现大量重复请求同一图片资源,可能影响站点性能,此时需优化robots.txt规则限制不必要的内容。

- 交互优势:相比纯文本日志,图形化界面更直观地展示趋势变化,尤其适合非技术背景的用户快速掌握整体状况。

结合实时监测工具扩展能力

- 集成第三方分析平台

- 补充方案:对于大型站点,可将服务器日志同步至百度统计、站长平台的抓取诊断模块,或者接入Sentry等APM系统实现毫秒级监控,这些工具不仅能追踪蜘蛛行为,还能关联SEO效果评估。

- 自动化处理:借助ELK Stack搭建日志分析栈,利用Kibana创建仪表盘动态呈现蜘蛛访问热力图,进一步提升数据处理效率。

注意事项与常见问题规避

| 场景 | 解决方案 | 原因 |

|---|---|---|

| 日志过大导致卡顿 | 按日期切割日志文件,定期清理旧数据 | 避免单一文件超出内存限制 |

| UA字段缺失 | 确保Web服务器未屏蔽User-Agent头信息,检查防火墙规则是否拦截合法请求 | 某些安全策略可能导致误杀真实爬虫 |

| IP地域分布异常 | 交叉核对多个来源的数据,优先信任来自北京、上海等地的主节点 | 排除CDN节点干扰造成的地理位置偏差 |

FAQs

Q1: 如果日志里没有找到任何Baiduspider记录怎么办?

A: 首先确认网站已正确提交至百度站长平台并完成验证;其次检查robots.txt是否存在禁止全网抓取的规则;最后尝试主动推送重要页面链接给百度,促使其重新调度爬虫任务,新上线的网站可能需要等待一段时间才能被自然发现。

Q2: 如何区分百度蜘蛛和其他搜索引擎的爬虫?

A: 主要依据User-Agent字符串中的关键字段进行辨别,百度使用的是“Baiduspider”,而谷歌为“Googlebot”,搜狗则是“Sogouspider”,同时结合IP段归属进一步验证,确保不会混淆不同厂商

(图片来源网络,侵删)